NVIDIA DGX Spark - オンプレミスAIのためのコンパクトGPUサーバーの誕生

2025年5月、NVIDIAはAIインフラの新しい基準としてDGX Sparkという名前の小型高性能GPUサーバーを発表する予定です。まだ正式な発売日は確定していませんが、公開された仕様とNVIDIAの戦略を通じて、この製品がどのようなものなのか、AI関連ビジネスでどのように活用できるかをあらかじめ確認してみましょう。

DGX Sparkとは何か?

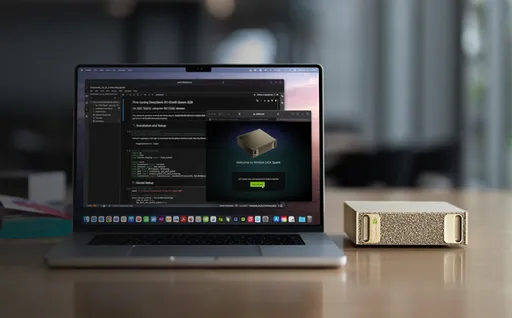

DGX Sparkは、NVIDIAの既存のDGXシステム(例: DGX H100, A100)の哲学を引き継ぎ、コンパクトなフォームファクターでも強力なAI性能を提供するオンプレミスAIソリューションです。

✅ 主な目的

- AIスタートアップ、中小企業、研究機関のための自社AIインフラ構築

- 個人情報保護とデータ主権が重要な環境でのクラウドの代替手段

- 低電力、低騒音、デスクトップレベルのGPUサーバーによる実験と推論の最適化

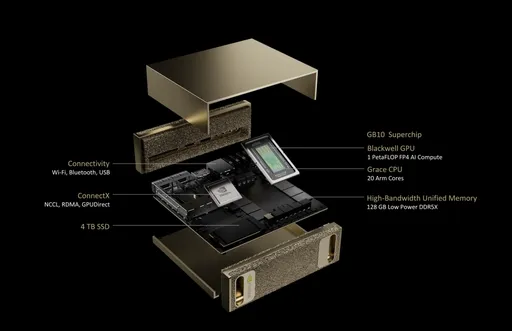

DGX Sparkの予想仕様 (公開情報に基づく)

| 項目 | 仕様 (予想または漏洩に基づく) |

|---|---|

| GPU | 1~2個 NVIDIA Blackwell ベースのGPU (例: B100またはGB200) |

| メモリ | 128GB ~ 192GB HBM3e |

| ストレージ | 高速NVMe SSD (TB単位で拡張可能) |

| ネットワーク | 10/100Gb EthernetまたはNVLinkサポートの可能性 |

| 電力消費 | 800W ~ 1200W予想 |

| フォームファクター | デスクトップタワー型または4Uラックマウント型 |

⚠️ スペックは後日公式リリース時に更新予定です。

DGX Sparkの代表的な活用分野

1. ローカルAIモデルの学習とファインチューニングプラットフォーム

- 中小型LLM、ビジョンモデルなどを自社構築

- GPUサーバーを基盤とした社内AI R&D実験環境

2. オンプレミスAI推論インフラ

- プライベートチャットボット、ドキュメント検索、エッジAI分析サーバーの構築に適している

- AIデータセキュリティ、クラウドの代替が必要な業界で需要が期待される

3. エッジAIの展開と産業自動化

- 製造、金融、ヘルスケアなどのエッジコンピューティング環境に適している

- NVIDIA AI Enterpriseと組み合わせると、強力なGPU基盤の推論最適化が可能

4. 教育・研究機関、スタートアップのGPU実験インフラ

- 高コストのDGXの代わりに、小規模GPUサーバーでの投資対効果を確保

- クラウドGPUコストの代替を希望するユーザーに現実的なソリューション

なぜDGX Sparkは業界で注目されているのか?

- オンプレミスAIインフラ市場が成長中であり、クラウドリスク回避需要が増加している

- GPUサーバー市場でコンパクトな高性能設備への関心が高まっている

- データ主権・セキュリティ問題によりローカル推論サーバーの需要が急増している

- エッジAI、AI推論最適化、プライベートクラスター運営のトレンドに一致している

結論: 誰のためのAI GPUサーバーなのか?

DGX Sparkは: - 大型データセンターではなく、机上のAIスーパコンピュータ - クラウド+オンプレミスハイブリッド戦略を追求するチームへの現実的な選択肢 - AI R&D、セキュリティセンシティブサービス、産業エッジ展開まで幅広く活用可能

NVIDIA DGX Sparkは単なるサーバー以上の存在です。 AI時代のコンピューティングがクラウドからローカルに戻ってくる時点で、 プライベートGPUインフラの標準となる可能性が非常に高いです。

コメントはありません。