今やAIは、巨大なクラウドサーバーだけのものではなく、個人のノートパソコンやデスクトップPCでも十分に扱える技術へと進化しています。こうした変化を可能にした中核技術の一つがllama.cppプロジェクトであり、その中心にあるのがGGUF(GPT-Generated Unified Format)フォーマットです。

この記事では、GGUFの構造的特性と設計思想、そしてなぜこのフォーマットがローカルLLMエコシステムの標準になったのかを詳しく掘り下げます。

1. GGUFとは何か?

GGUFは、GGML(Georgi Gerganov Unified Formatではなく、従来のGGML系譜を受け継ぐ新しいモデルフォーマット)の後継としてllama.cppチームが設計した、統合型のモデルファイルフォーマットです。

従来のGGMLが主にテンソル(重み)を保存する構造だったのに対し、GGUFはモデルをより完全な形で「パッケージ化」するための新しいアーキテクチャを示しています。

従来のPyTorch .pthやHugging Faceの.safetensorsファイルは、基本的にモデルの重みだけを保存します。そのため、読み込み時にはトークナイザーや設定ファイル、アーキテクチャ情報を別途読み込む必要があります。

一方、GGUFは重み、メタデータ、トークナイザー、ハイパーパラメータを1つのバイナリファイル内に統合します。

つまり、「モデルを移動させる」という行為は、コードや設定を含む複雑な作業ではなく、1つのファイルをコピーするだけの作業へと簡素化されました。

このような設計の背景には、「読み込みの完全性(Complete Loadability)」という思想があります。つまり、どのハードウェア環境でも、同じGGUFファイルが同様に読み込まれ、動作すべきだという考え方です。

2. GGUFの主な技術的特徴

GGUFは単なるファイルフォーマットではなく、効率的なローカル推論を実現するための一種のシステム設計パラダイムでもあります。

(1) 単一ファイル構造

GGUFは、必要なデータを1つのバイナリファイルに統合します。これはファイルアクセス(I/O)の効率向上だけでなく、モデル配布の簡素化にもつながります。 ファイル内部は、ヘッダー(Header)、メタデータ(Key-Value Dictionary)、テンソルブロック(Tensor Blocks)で構成されています。

この構造により、新しいフィールドが追加されても下位互換性を保ちやすくなっています。たとえば、prompt_formatのような新しいメタデータが追加されても、古いローダーはそれを無視でき、最新のローダーは正しく認識できます。

(2) Memory Mapping(mmap)

GGUFは、OSレベルのメモリマッピング(mmap)機能を積極的に活用しています。これは、ファイル全体を一度にRAMへ読み込むのではなく、必要なブロックだけをその都度読み込む方式です。 つまり、10GBのモデルを実行する場合でも、実際にその時点でメモリに展開されるのは「現在計算に必要なテンソル」が中心です。そのため、メモリの少ない環境でも大規模モデルを動かしやすいという利点があります。

(3) ハードウェアアクセラレーションとオフロード(Offloading)

GGUFは基本的にCPUでの実行を前提に設計されていますが、GPUが利用できる環境では、一部の行列演算をGPUへオフロードすることも可能です。 この構造的な柔軟性により、GGUFはCPUのみ、CPU+GPUのハイブリッド、GPU支援ありといった複数の実行モードに対応し、さまざまなプラットフォームで一貫した運用を可能にしています。

3. 量子化(Quantization)の深い理解

GGUFフォーマットの最大の革新の一つは、単にモデルを「保存」するだけでなく、モデルの数値精度を「再構成(量子化)」できる点にあります。 量子化とは、もともと浮動小数点数(たとえばFP16やFP32)で表現されていた重みを、より低いビット精度(たとえば4bitや5bit)に圧縮する処理です。 その結果、ファイルサイズやメモリ使用量は大幅に削減されますが、モデルの意味的な性能は比較的よく維持されます。

(1) 量子化表記(Qn_K_M、Q8_0など)の意味

GGUFで使われる量子化方式の名前は、単なる略称ではなく、内部アルゴリズムの構造を反映した記号です。

- Q : Quantization(量子化方式)

- 数字(n) : 1つの重みを表現するのに使われるビット数(例:Q4 → 4ビット)

- K : Kブロック量子化(K-Block Quantization)を意味し、行列をブロック単位に分けて独立して量子化する構造を指します。

たとえば

Q4_Kでは、重みテンソルをブロックごとに分割し、各ブロックごとにスケール(scale)や補正情報を個別に計算します。 こうすることで局所的な特性を反映でき、単純な全体量子化よりも高い精度を保ちやすくなります。 - M : Mixed Precisionを意味します。 一部のテンソル、特に重要な部分はより高い精度で保持し、それ以外は低い精度で保存する方式です。 つまり、モデル内部の重要度に応じて精度を使い分ける手法です。

- 0 : 非Kブロック構造を表します。つまり、Kブロック単位ではなく、より単純な全体スケール型の量子化です。構造は単純ですが、細かな精度調整は難しくなります。

(2) 各量子化方式の原理と適用文脈

| 量子化タイプ | 技術的説明 | 内部メカニズム | 推奨使用環境 |

|---|---|---|---|

| Q2_K | 2ビット量子化。理論上は非常に高い圧縮率を持つ | 各ブロック単位でスケールを使って値を復元 | 極端にメモリが限られた環境(Raspberry Pi、エッジデバイスなど) |

| Q3_K_M | 3ビット量子化 + Mixed Precision | 基本は3ビットだが、重要なテンソルにはより高い精度を使用 | 低スペックのノートPC、組み込み環境 |

| Q4_K_M | 4ビット量子化の事実上の標準 | バランスのよいブロックスケーリングとグループ量子化 | 一般ユーザー向け(MacBook、ゲーミングPCなど) |

| Q5_K_M | 5ビット量子化で、精度低下をさらに抑える | より細かいスケール表現が可能 | メモリに比較的余裕のある環境 |

| Q6_K | 高精度寄りの量子化 | ブロック単位で高い再現性を保つ | 高品質な推論を重視する環境 |

| Q8_0 | 8ビットの単純量子化 | 元の性能にかなり近い | GPU環境や高性能ワークステーション |

一般的に、Q4_K_Mは容量と品質のバランスが最も優れたスイートスポットと見なされます。Kブロック構造による局所精度と4ビット圧縮のバランスが良く、現在の多くのCPU/GPU実行環境(AVX、Metal、CUDA)とも相性が良いためです。

4. GGUFの設計上の強み

- プラットフォーム非依存性 CPU、GPU、Apple Siliconなど、さまざまなハードウェア上で同じバイナリファイルを使って推論できます。

- 読み込み効率 mmapベースのストリーミング読み込みにより、数GB規模のモデルでも扱いやすくなっています。

- 高い再現性(Reproducibility) ファイル内部にトークナイザーやパラメータが含まれているため、同じGGUFファイルを使えば環境差を減らしながら再現しやすくなります。

- エコシステムの拡張性

llama.cppを中心に、Ollama、LM Studio、LocalAI、llama-cpp-pythonなど、さまざまなツールで標準的に採用されています。

5. 限界と現実的な考慮点

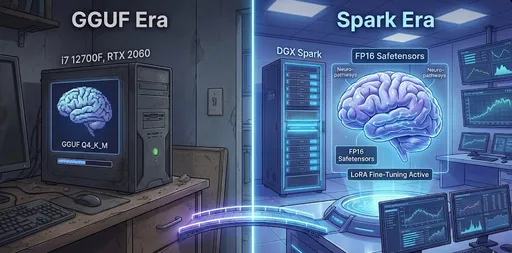

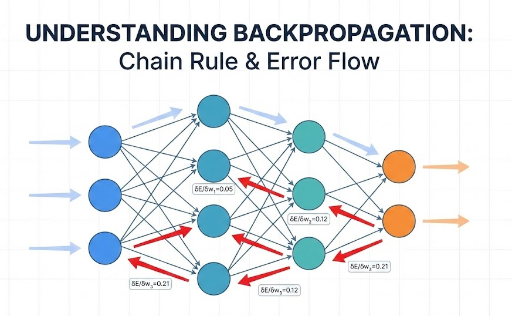

- 学習(Training)には向いていない GGUFはあくまで「推論最適化フォーマット」であり、逆伝播(backpropagation)に必要な精度や表現を前提としていません。 そのため、ファインチューニングやLoRAなどの追加学習を行う場合は、通常FP16など別の形式へ戻す必要があります。

- GPU専用フォーマットに比べると速度面で不利な場合がある EXL2、AWQ、GPTQなどのGPU寄りのフォーマットは、GPUの行列演算をより直接的に活用できるため、トークン生成速度で優位になることがあります。 ただし、それらはCUDA環境に強く依存することが多く、CPUやMetalなどの汎用プラットフォームでは制約もあります。 GGUFは速度だけでなく、汎用性とアクセシビリティを重視した設計思想を持っています。

6. 結論:GGUFは「個人向けAIの標準フォーマット」

GGUFの登場により、大規模言語モデルはもはや研究所や大企業だけのものではなくなりました。 ローカル環境での推論効率、単一ファイルによる扱いやすさ、ハードウェア非依存性という3つの軸を実現したことで、GGUFは事実上、ローカルLLMのデファクトスタンダードとなっています。

もしMacBookや一般的なPCで、Llama 3、Mistral、Phi-3などの最新モデルを動かしたいのであれば、 その出発点はまず、GGUF形式のモデルをダウンロードすることです。

コメントはありません。