AI语音识别市场正在迎来创新。今年5月,NVIDIA发布了下一代开源语音识别模型parakeet-tdt-0.6b-v2,以威胁Whisper。这个模型经过GPU优化,展示了在实时语音处理、自动会议记录、音频转写、AI语音识别API和基于广告收入的内容生成等方面的商业应用潜力,正在动摇AI语音识别市场的格局。

基于FastConformer + TDT的快速语音识别引擎

parakeet-tdt-0.6b-v2是一个仅识别英语的模型,拥有约6亿个参数。该模型由以下两种技术结构组成:

- FastConformer编码器:旨在有效分析语音特征,并设计为在NVIDIA图形卡(GPU)上快速运行。这使得处理复杂语音变得更快、更精准。

- TDT解码器(Transducer-Decoder Transformer):在将声音转换为文字的过程中具有优势,特别是在处理长音频文件时能够稳定而无间断地进行。

得益于这两种结构,该模型可以在音频时长再长的情况下保持速度不变,并且在实时将语音快速精确地转换为文字方面进行了优化。

速度比Whisper快数千倍,最适合商业服务

根据官方基准测试:

- RTFx(实时因子):3386.02(以批量128为基础)

- WER(词错误率):6.05%

与平均RTFx为2~5的Whisper-large-v3相比,Parakeet以数千倍的速度而自豪。

实际实验结果更加令人印象深刻。我故意使用了一段背景音混杂的3分40秒歌曲音源来进行测试。完成转写所花费的时间仅为13秒。这个惊人的结果包含了以下要素:

- 尽管有背景音,时间戳准确映射

- 标点符号和大小写的自动化几乎完美

- 歌词中将‘you’书写为‘ya’,生动反映了实际说话者的语气和表达

然而,当测试中加入日语或韩语音频时没有任何输出。这明确表明这是一个专门针对英语的ASR模型。

AI语音识别引擎比较:NVIDIA Parakeet vs OpenAI Whisper

| 项目 | NVIDIA Parakeet | OpenAI Whisper |

|---|---|---|

| 语言支持 | 仅支持英语 | 多语言(98种以上) |

| 模型结构 | FastConformer + TDT | 卷积 + Transformer |

| 速度(RTFx) | 超过3000 | 2~5 |

| 许可证 | 开源(商业使用) | 开源(商业使用) |

| 音质鲁棒性 | 对包含音乐的音频较强 | 相对较弱 |

| 多模态关联 | 无 | 可与GPT关联 |

虽然Whisper在多语言处理方面占据优势,但Parakeet在实时语音处理和准确性方面则显得卓越。

商业使用的考量因素

- 不支持英语以外的语言(韩语/日语测试结果无反应)

- 在高噪音环境下,可能对比Whisper更敏感

- 不支持多模态分析(例如,语义解释)

但有以下期待因素:

- 通过Common Voice等实现多语言微调的可能性

- 在会议记录、法庭记录、采访转写等实际应用中具有较高的实用性

- 易于作为基于Whisper的服务的替代后端

- 适合用作提供AI语音识别API服务的引擎

技术创新:基于CTC的实时处理结构

Parakeet能够最大化速度的关键在于CTC(连接主义时序分类)方式。语音数据通常长而复杂,每个单词被说出的时刻各不相同。要将它们精确地按人说话的顺序转写为文字并非易事。

CTC是一种能够从复杂的音频流中提取关键信息,并自动对齐和匹配哪个地方是哪个字母的技术。此外,CTC可以一次同时处理多个片段,非常快速。

因此,Parakeet能够实时接受语音,同时无延迟地按字母、按单词进行输出,并且无论音频长度如何都能保持一定的速度。可以将其看作像速记员那样实时记录,但其算法比打字快得多。

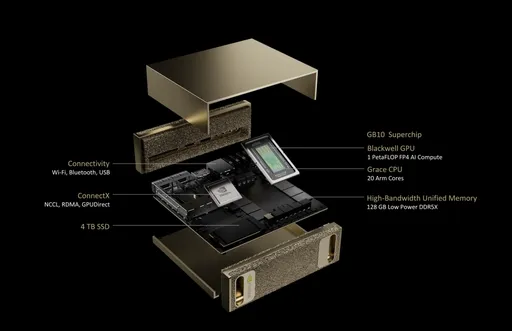

NeMo + Hugging Face:统一的AI生态系统战略

Parakeet模型通过以下统一结构增强了NVIDIA的AI生态系统战略:

- 与NeMo工具包完全集成

- 提供可直接在Hugging Face上使用的管道

- 作为GPU优化模型,引导硬件需求

这不仅仅是一个模型,而是一种在“NVIDIA硬件上运行最快的开源AI模型”的战略品牌。

结论:AI转录服务开发者的新武器

Whisper仍然强大,但现在Whisper并不是唯一的解决方案。

NVIDIA Parakeet有:

- 可用于商业的开源模型和

- 为实时转录优化的AI语音识别引擎,并且

- 可轻松融入自动会议记录、音频内容转写、广告收入相关内容的生产等多种实际工作中,并且

- 在与谷歌AdSense高单价关键词相关的AI语音内容运营方面理想。

对于所有考虑实时语音处理、AI音频转写服务和GPU优化语音识别系统的开发者和服务策划者来说,NVIDIA Parakeet将成为一个兼具速度、质量和商业性的战略替代方案。

目前没有评论。